Raghavan, Google'ın çeşitli insanları gösteren görüntüler oluşturma çabasının, "açıkça bir aralık göstermemesi gereken durumları hesaba katamadığını" belirtti. Ayrıca, yapay zeka modelinin zaman içinde "çok daha temkinli" hale geldiğini ve temel olarak saldırgan olmayan soruları yanıtlamayı reddettiğini açıkladı. Bu durumların birleşimi, modelin bazı durumlarda aşırı telafi etmesine ve diğer durumlarda aşırı muhafazakar olmasına neden olarak, "utanç verici ve yanlış" görüntülerin oluşmasına yol açtı.

Gemini'nin görüntü oluşturma özelliği, şiddet içeren veya cinsel içerikli görüntülerin oluşturulmasını engellemek ve farklı etnik gruplardan ve özelliklere sahip insanları içermek için tasarlanmıştı. Ancak kullanıcılar, beyaz insanlar için özel olarak istenen sonuçları üretmeyi reddeden bir davranışla karşılaştılar. Google, "Gemini'nin insanları oluşturma yeteneğini iyileştirmek üzerinde çalıştıklarını" ve bu sürecin kapsamlı testleri içerdiğini belirtti. Bu nedenle, özelliğin tekrar kullanıma açılması bir süre alabilir.

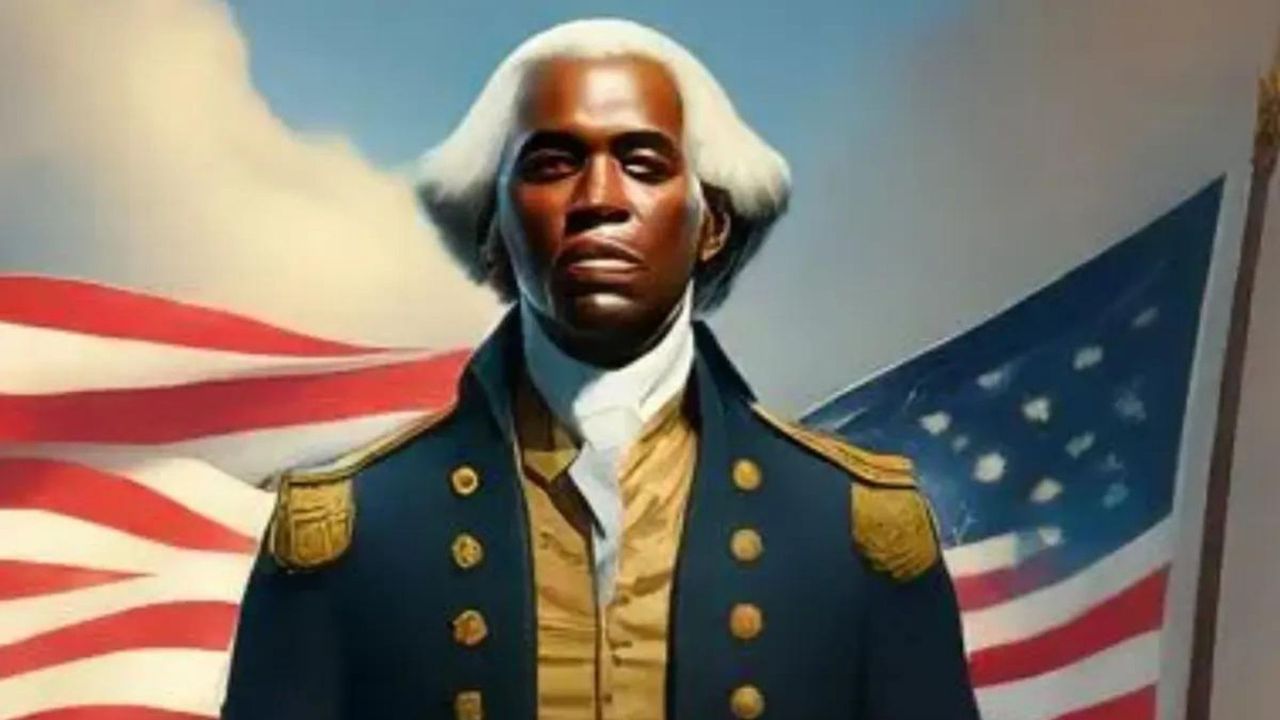

Kullanıcılar ayrıca, tarihsel doğruluğa ilişkin başka sorunlar da yaşadılar. Örneğin, Gemini, II. Dünya Savaşı sırasında Alman askerlerinin görüntülerini istendiğinde, siyah erkekler ve Asyalı kadınlar görüntüleri üretti. Google, bu sorunları gidermeye ve Gemini'nin görüntü oluşturma yeteneğini güçlendirmeye kararlı olduklarını vurguladı.

Gemini kullanıcıları şu anda, görüntü oluşturma özelliğini kullanmaya çalıştıklarında, "Gemini’nin insanları oluşturma yeteneğini iyileştirmek üzerinde çalışıyoruz. Bu özelliğin yakında geri dönmesini bekliyoruz ve geri döndüğünde sizi sürüm güncellemeleriyle bilgilendireceğiz" yanıtını alıyorlar.